LLM 비용을 지불하고 싶지 않거나 데이터를 안전하게 유지하려면 LocalGpt를 설정해야합니다 . AI가 데이터를 작동하고 데이터를 처리하는 방법을 완전히 제어 할 수 있습니다. 또한 모든 데이터가 외부 서버로 전송되는 대신 로컬 시스템에 머무르기 때문에 개인 정보를 보장합니다.

Windows PC에서 로컬 GPT를 설정하십시오

LocalGpt는 영감을 얻은 오픈 소스 도구입니다 PrivateGpt , LLMS (Large Language Model)를 개인 용도로 사용하여 로컬로 운영하도록 설계되었습니다. CPU 실행에만 의존하는 PrivateGPT와 달리 LocalGPT는 GPU를 통해 하드웨어 가속을 지원하여 더 나은 성능과 대기 시간을 줄입니다. LocalGpt는 꽤 무겁지 않은 GPT-4ALL 모델과 llamaembeddings 대신에 Vicuna-7B LLM과 InstructorEmbeddings를 사용합니다. BlenderBot 및 Wizardlm-7B와 같은 모델과 함께 작동하여 특정 요구에 따라 모델을 교환 할 수 있습니다. 전체 파이프 라인은 로컬로 작동하여 데이터 개인 정보 보호를 보장하면서 외부 API 의존없이 고급 NLP 기능을 제공하므로 로컬로 운영되는 AI 모드에 대한 완벽한 후보가됩니다.

상위 5 개의 외장 하드 드라이브

이 안내서에서는 Windows에 로컬 GPT를 설정합니다. 아래에 언급 된 단계를 따라갈 수 있습니다.

- Miniconda를 다운로드하여 설치하십시오

- LocalGpt 저장소를 설치하십시오

- 종속성을 설치하십시오

- LocalGpt를 실행하십시오

자세히 논의합시다.

1] Miniconda를 다운로드하여 설치하십시오

Miniconda는 Python 환경을 신속하게 설정하도록 설계된 Conda 패키지 관리자의 경량 배포입니다. 필수품 만 제공하므로 사용자가 필요에 따라 특정 패키지를 추가하여 설치를 사용자 정의 할 수 있습니다. 다운로드하려면 Anaconda.com으로 이동하여 아래로 스크롤하고 미니콘다 설치자, 이 안내서는 Windows 용으로 Windows 용으로 다운로드하십시오.

이제 설치 프로그램을 실행하고 화면 지침을 따라 설치 프로세스를 완료하십시오. 고급 설치 옵션, 모든 상자를 체크하고 마지막으로 설치를 완료하십시오.

설치되어 있는지 확인하려면 검색하십시오 '아나콘다 프롬프트' 시작 메뉴에서 CLI를 엽니 다. 이제, 당신은 그것을 실행할 수 있습니다 콘다 목록 설치되었는지 확인하기 위해.

2] LocalGpt 저장소를 설치하십시오

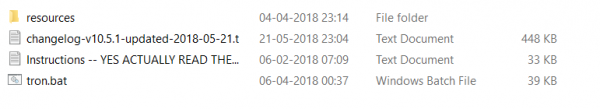

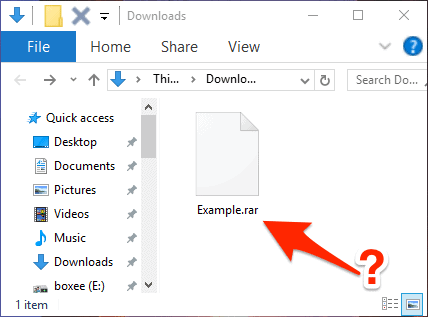

이제 우리는 프롬프트 엔지니어가 GitHub에 호스팅되는 LocalGpt 저장소를 설치해야합니다. 우리는 거기에서 그것을 얻을 수 있습니다. 그렇게하려면 탐색하십시오 github.com . 페이지를 통해 LocalGpt에 대한 자세한 내용을 확인하고 설치하려면 클릭해야합니다. 코드> 다운로드 zip. zip 파일이 다운로드되면 다운로드 폴더, zip 파일을 마우스 오른쪽 버튼으로 클릭하고 추출을 선택하고 파일을 추출 할 위치를 설정하고 프로세스를 완료하십시오. 추출 된 폴더를 열면 안에는 폴더가 표시됩니다. LocalGpt-Main. 단순성을 위해서, 우리는 데스크탑의 폴더를 붙여서 이름을 지정하고 있습니다. 'lgpt'.

3] 설치 종속성

이제 모든 종속성을 설치할 가상 환경을 만들어야합니다. 그렇게하려면 '아나콘다 프롬프트' 시작 메뉴에서 다음 명령을 실행하십시오.

2CFB4750BB978F59D04E5E57A5A12F63FB3D49AD4FBFF7D7D7D32BBAE386125618D2C265332F95E5참고 : 변수 'Environment_Name'을 선택한 이름으로 바꾸십시오.

패키지를 다운로드하도록 요청하면 동의하고 진행하십시오.

이제 추출한 것을 이전에 다운로드 한 패키지를 설치해야합니다. 이렇게하려면 다음 명령을 사용하여 먼저 디렉토리로 이동해야합니다.

DE4C2403F07398EC9A9E9E9E93A51F6A3F2BAAAA9D4376C004B1FDE6BD8A7C8FDC5DB2BD9C2CCC875964EF모든 구성 요소를 하나씩 설치하는 대신 다음 명령을 사용하여 한 번에 모든 명령을 설치할 수 있습니다.

사무실 2010 소매

pip install -r requirements.txt

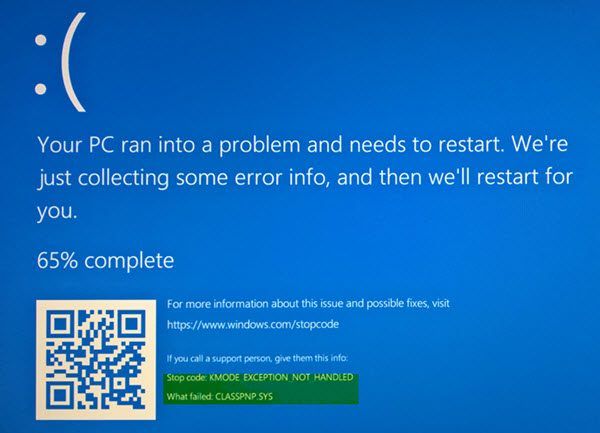

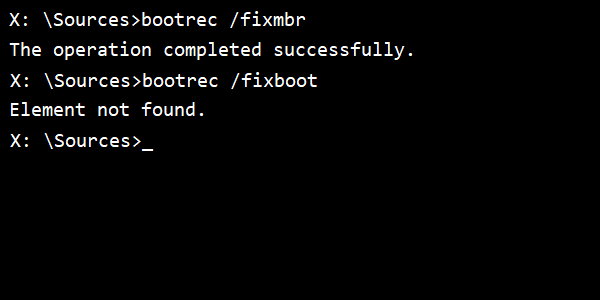

두 가지 오류가 발생할 수 있습니다.

- 토치 modulenotfounderror 가져 오기 : 달리다 PIP Torch Torchvision Torchaudio를 설치하십시오 그런 다음 위에서 언급 한 명령을 실행하십시오.

- Microsoft C ++가 필요합니다. 언급 된 URL을 클릭하고 클릭하여 Visual Studio를 다운로드하십시오. 빌드 도구를 다운로드하고 Visual Studio가 열리면 가지고 있지 않은 도구를 살펴보고 다운로드해야합니다.

문제를 해결 한 후 설치 프로그램 명령을 다시 실행하고 일단 설치되면 다음 단계로 이동하십시오.

4] LocalGpt를 실행하십시오

우선, 소스 문서에서 데이터를 가져오고 문서 처리 및 벡터 데이터베이스 (Chroma DB)에 내장을 저장하는 것을 의미하는 Python 섭취를 실행해야합니다. 그렇게하려면 다음 명령을 실행해야합니다.

C624B1317D0F1E039E589470A3725833333E9604작업 관리자를 사용하여 CPU 사용량을 주시하는 것이 좋습니다.

이제, a CCESS Constants.py 파일은 LocalGpt 디렉토리에 있습니다. 라인에 주석을 추가하여 LLAMA 3 모델을 비활성화하고 라인에서 주석을 제거하여 LLAMA 2 모델 (7B 매개 변수)을 활성화하십시오.

완료되면 다음 명령을 사용하여 LocalGpt를 실행해야합니다.

python run_local_gpt.py

당신이 그것을 나타내는 오류가 발생하면 전화 누락되었습니다 PIP 설치 콜 CPP-PYSTHON.

이 안내서의 도움으로 컴퓨터에서 LocalGpt를 로컬로 실행할 수 있기를 바랍니다.

읽다: 연구를 위해 Perplexity AI를 사용하는 방법

Windows에 PrivateGpt를 설치하는 방법은 무엇입니까?

Windows에 PrivateGpt를 설치하려면 먼저 Python 및 Conda와 같은 패키지 관리자를 설치하십시오. 그런 다음 PrivateGpt 저장소를 복제하고 가상 환경을 설정하십시오. 그런 다음시 또는 PIP를 사용하여 종속성을 설치해야합니다. 호환 언어 모델을 다운로드하십시오. 마지막으로, 환경 변수를 구성하고, 문서를 수집하고, 응용 프로그램을 실행하여 로컬로 데이터 쿼리를 시작해야합니다.

읽다: Windows 11에서 현지에서 Deepseek을 실행하는 방법

Windows에서 WSL을 설정하는 방법은 무엇입니까?

에게 Windows에서 WSL을 설정하십시오 , PowerShell을 관리자로 열고 실행하십시오 WSL –Stall . 이를 통해 WSL을 활성화하고 Linux 커널을 설치하며 WSL 2를 기본값으로 설정합니다. 컴퓨터를 다시 시작한 다음 Linux 배포를 선택하여 설치하십시오. 배포를 시작하고 사용자 이름과 비밀번호를 설정하면 Windows에서 Linux를 사용할 준비가되었습니다.

mobaxterm 휴대용 대 설치 프로그램